Transfer learning: kaip maksimaliai išnaudoti esamus dirbtinio intelekto modelius

Sužinokite, kaip taikyti transfer learning esamuose dirbtinio intelekto modeliuose: nuo vaizdų ir teksto iki garso analizės. Praktiniai žingsniai, geriausios praktikos ir verslo pritaikymo pavyzdžiai.

Transfer learning (žinių perkėlimo metodas) per pastaruosius kelerius metus tapo vienu svarbiausių dirbtinio intelekto proveržių. Vietoj to, kad kiekvieną kartą kurtume modelį nuo nulio, galime pernaudoti jau išmoktas didelių modelių žinias ir pritaikyti jas naujoms, siauresnėms užduotims. Tai leidžia ženkliai sutaupyti laiką, duomenis ir resursus, kartu dažnai pasiekiant geresnius rezultatus.

Kas yra transfer learning?

Transfer learning – tai metodas, kai modelis, išmokytas spręsti vieną užduotį, panaudojamas kaip atspirties taškas kitai, giminingai užduočiai. Užuot pradėję mokymą nuo atsitiktinių svorių, mes pradedame nuo jau suformuotų reprezentacijų, kurios buvo išmoktos iš didelių, įvairių duomenų rinkinių.

Intuityviai tai labai panašu į žmogaus mokymąsi: jei jau mokate vieną kalbą, išmokti kitą tampa lengviau. Panašiai ir modelis, kuris mokytas atpažinti milijonus vaizdų ar analizuoti milžiniškus tekstų kiekius, sukaupia universalių žinių, kurias galima „perkelti“ į naujas užduotis.

Kodėl verta naudoti transfer learning?

Transfer learning privalumai ypač ryškūs, kai kalbame apie realius verslo ar produktų scenarijus, kuriuose dažnai trūksta duomenų, laiko ir infrastruktūros. Šį metodą verta rinktis dėl kelių priežasčių.

- Mažiau duomenų. Vietoj šimtų tūkstančių pavyzdžių dažnai pakanka kelių tūkstančių ar net kelių šimtų kokybiškų įrašų.

- Greitesnis mokymas. Kadangi bazinės reprezentacijos jau išmoktos, modelį adaptuoti reikia ženkliai mažiau epochų ir resursų.

- Geresni rezultatai. Iš anksto išmokyti modeliai dažnai pasižymi geresniu apibendrinimu, ypač jei naujos užduoties duomenys riboti.

- Mažesnės sąnaudos. Nebereikia gigantiškų klasterių ir ilgų treniruočių – pakanka gerai sukonfigūruoto GPU ar net CPU.

- Lankstumas. Tą patį iš anksto išmoktą modelį galima pritaikyti kelioms skirtingoms užduotims, taip taupant kūrimo laiką.

Kaip veikia transfer learning praktikoje?

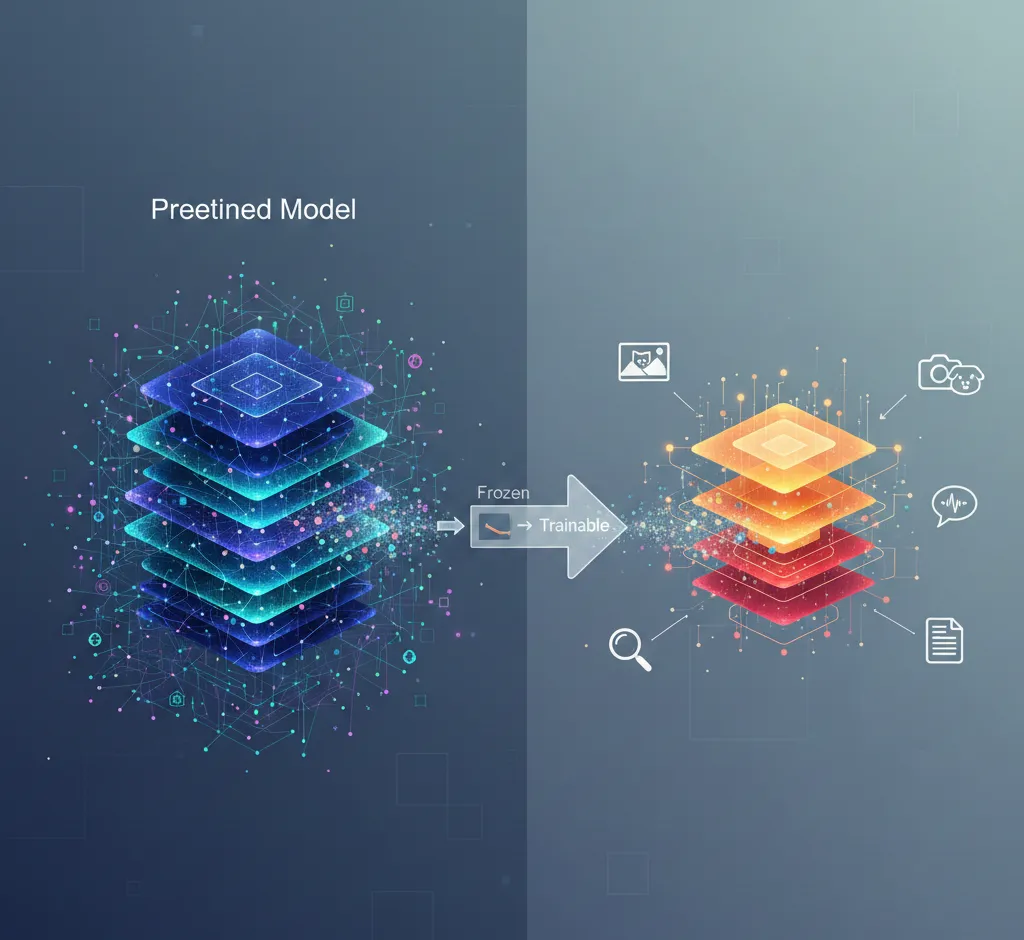

Transfer learning esmė – dirbti ne su visiškai nauju modeliu, o su jau iš anksto apmokytu tinklu (angl. pretrained model). Toliau jis dažniausiai adaptuojamas (angl. fine-tuning) naujai užduočiai.

Pagrindiniai žingsniai

- Pasirinkti bazinį modelį. Parenkamas modelis, apmokytas ant didelio atitinkamos srities duomenų rinkinio (pvz., ImageNet vaizdams, BERT tekstui, wav2vec2.0 garsui).

- Pakoreguoti architektūrą. Dažniausiai pakeičiamas paskutinis sluoksnis ar keli sluoksniai, kad atitiktų naują užduotį (pvz., kitoks klasių skaičius).

- Užšaldyti arba dalinai užšaldyti sluoksnius. Dalis sluoksnių paliekami nefiksuoti mokymui arba užšaldomi, kad būtų išsaugotos bendrinės žinios.

- Fine-tuning etapas. Modelis mokomas ant naujo, siauresnio duomenų rinkinio, dažnai su mažesniu mokymosi greičiu, kad „nepamirštų“ ankstesnių žinių.

- Vertinimas ir optimizavimas. Tikrinama, ar modelis neperdėtai pritaikytas (angl. overfitting) ir jei reikia, taikoma reguliariacija ar duomenų papildymas (angl. data augmentation).

Užšaldyti ar ne – kada ir kodėl?

Vienas iš praktinių klausimų taikant transfer learning – kuriuos sluoksnius mokyti, o kuriuos palikti fiksuotus. Sprendimas priklauso nuo užduoties panašumo į pirminę.

- Jei nauja užduotis labai panaši į pradinę (pvz., taip pat nuotraukų klasifikavimas), dažnai galima užšaldyti didžiąją dalį sluoksnių ir mokyti tik paskutinius.

- Jei nauja užduotis gana skirtinga (pvz., iš bendro teksto modelio pereinama prie medicininių dokumentų analizės), verta leisti atnaujinti daugiau sluoksnių.

Tokiu būdu balansuoja tarp jau turimų žinių išsaugojimo ir naujos informacijos įsisavinimo.

Transfer learning taikymas esamuose vaizdų modeliuose

Kompiuterinė rega yra viena iš sričių, kur transfer learning naudojamas ypač plačiai. Modeliai, tokie kaip ResNet, EfficientNet, MobileNet ar Vision Transformer (ViT), dažniausiai apmokyti ant milžiniško ImageNet duomenų rinkinio ir gali būti lengvai adaptuojami įvairioms nišinėms užduotims.

Tipinis scenarijus: vaizdų klasifikavimas

Įsivaizduokime, kad turite elektroninę parduotuvę ir norite automatiškai klasifikuoti produktų nuotraukas į tam tikras kategorijas. Jūsų duomenų kiekis ribotas, o sukurti pilnai naują konvoliucinį tinklą būtų brangu.

- Pasirenkate iš anksto apmokytą modelį (pvz., ResNet50) iš viešai prieinamų bibliotekų (PyTorch, TensorFlow, Keras).

- Pašalinate paskutinį klasifikavimo sluoksnį ir jį pakeičiate nauju tankiuoju sluoksniu, atitinkančiu jūsų klasių skaičių.

- Užšaldote ankstesnius sluoksnius, kad jie išlaikytų universalių vaizdinių bruožų atpažinimą.

- Mokote tik naują sluoksnį ant savo produktų nuotraukų rinkinio, pasiekdami gerus rezultatus su palyginti nedaug duomenų.

Jei rezultatų neužtenka, galima atrakinti dalį gilesnių sluoksnių ir tęsti fine-tuning su mažesniu mokymosi greičiu, taip labiau pritaikant modelį konkrečiai domeno specifikai.

Objektų detekcija ir segmentacija

Transfer learning plačiai naudojamas ir sudėtingesnėse užduotyse, tokiose kaip objektų detekcija (pvz., YOLO, Faster R-CNN) ar semantinė segmentacija (pvz., U-Net, DeepLab). Šiuose modeliuose dažnai naudojama iš anksto išmokyta backbone architektūra vaizdo bruožams išgauti.

- Backbone sluoksniai perkelia žinias apie bendrus vaizdų struktūrinius elementus.

- Galinių sluoksnių dalis (detekcijos „galvutė“, segmentacijos modulis) mokoma konkrečiai naujai užduočiai.

Taip išvengiama būtinybės nuo nulio mokyti didelius konvoliucinius ar transformerių pagrindo tinklus, kas reikalautų itin daug resursų.

Transfer learning NLP modeliuose

Natūralios kalbos apdorojime (NLP) transfer learning revoliuciją sukėlė iš anksto apmokyti kalbos modeliai: BERT, RoBERTa, GPT, T5, DistilBERT ir kiti. Šie modeliai mokomi ant gigantiškų tekstų korpusų, išmokdami bendrą kalbos struktūrą, sintaksę ir semantiką.

Teksto klasifikacija ir sentimentų analizė

Vienas paprasčiausių ir dažniausių transfer learning pavyzdžių NLP – teksto klasifikacija. Pavyzdžiui, norint nustatyti klientų atsiliepimų sentimentą, galima naudoti iš anksto apmokytą BERT modelį ir pridėti paprastą klasifikavimo sluoksnį.

- Įkeliame BERT bazinį modelį, kuris jau moka generuoti reikšmingas sakinių reprezentacijas.

- Prie jo galo prijungiame klasifikatorių (keletą tankiųjų sluoksnių), kuris prognozuoja klasių tikimybes (teigiamas, neigiamas, neutralus).

- Mokome visą sistemą kartu ant pažymėtų atsiliepimų duomenų rinkinio, naudodami mažesnį mokymosi greitį.

Tokiu būdu gauname galingą sentimentų analizės įrankį be būtinybės surinkti milžinišką kiekį treniravimo duomenų.

Klausimų–atsakymų sistemos ir paieška

Kitas dažnas pritaikymas – klausimų–atsakymų (QA) sistemos ir semantinė paieška. Čia transfer learning leidžia iš anksto apmokytus modelius pritaikyti konkrečiai žinių bazei, dokumentų rinkiniui ar domenei (pvz., teisė, medicina, finansai).

- QA modeliai (pvz., BERT fine-tuned ant SQuAD) gali būti papildomai apmokomi ant jūsų verslo dokumentų, kad geriau suprastų specifinę terminiją.

- Embeddings pagrindu veikiančios paieškos sistemos gali naudoti jau paruoštus sakinių reprezentacijų modelius (pvz., Sentence-BERT) ir adaptuoti juos konkrečioms užklausoms ir dokumentų tipams.

Naudojant šią strategiją įmanoma sukurti labai tikslias nišines paieškos ir dialogo sistemas, nenaudojant milžiniškų resursų.

Transfer learning garso ir laiko eilučių analizėje

Nors dažniausiai kalbama apie vaizdus ir tekstą, transfer learning vis plačiau taikomas ir kito tipo duomenims – garsui, signalams, laiko eilutėms. Pavyzdžiui, kalbos atpažinimo modeliai (wav2vec2.0, Whisper ir kt.) gali būti adaptuojami konkrečioms kalboms, dialektams ar teminėms sritims.

Laiko eilučių analizėje, tokiose srityse kaip finansai, IoT sensoriai ar prognozavimas, taip pat pradeda rastis iš anksto apmokyti modeliai, kuriuos galima fine-tuninti konkrečiai pramoninei ar verslo užduočiai.

Geriausios praktikos taikant transfer learning

Nors transfer learning iš pirmo žvilgsnio atrodo paprastas, norint pasiekti maksimalią naudą verta laikytis kelių svarbių principų.

1. Rinkitės tinkamą bazinį modelį

Būtina užtikrinti, kad bazinis modelis būtų:

- Paplitęs ir gerai dokumentuotas. Tai padės greičiau išspręsti technines problemas ir pasinaudoti bendruomenės patirtimi.

- Išmokytas ant panašios duomenų struktūros. Pvz., medicininių vaizdų užduotims dažnai verta rinktis modelius, treniruotus ant medicininių datasetų, o ne bendrų nuotraukų.

- Pakankamai lengvas arba optimizuotas. Ypač jei planuojate diegti modelį ribotuose įrenginiuose (mobiliosios programėlės, IoT).

2. Atidžiai valdykite mokymosi greitį

Fine-tuning metu mokymosi greitis (η) yra vienas iš kritinių hiperparametrų. Per didelis greitis gali „sugadinti“ iš anksto išmoktas žinias, o per mažas – sulėtinti mokymą iki neefektyvaus lygio.

- Dažnai ankstesniems sluoksniams taikomas mažesnis mokymosi greitis.

- Naujai pridėtiems sluoksniams gali būti taikomas šiek tiek didesnis greitis, nes jie išmoksta nuo nulio.

3. Naudokite duomenų papildymą ir reguliariaciją

Kadangi transfer learning dažnai naudojamas su palyginti nedideliais duomenų rinkiniais, didėja perapmokymo rizika. Tam mažinti naudinga:

- Vaizdams taikyti data augmentation (pasukimai, apkarpymai, šviesumo keitimas).

- Tekstams naudoti dropout, svorių reguliariaciją, atsargiai riboti sekų ilgį.

- Garso ir signalų analizėje taikyti triukšmo pridėjimą, laiko mastelio keitimą ir kitus metodus.

4. Stebėkite domeno perkėlimo ribas

Nors transfer learning labai galingas, jis ne visada veikia idealiai, ypač kai pirminė ir nauja užduotis labai skiriasi. Jei domenai per daug nutolę, modelio išmoktos reprezentacijos gali būti mažai naudingos, o kartais net trukdyti.

Todėl svarbu:

- Įvertinti pirminės ir naujos užduoties panašumą.

- Eksperimentuoti su skirtingais baziniais modeliais.

- Prireikus derinti transfer learning su daliniu mokymu nuo nulio ar specializuotomis architektūromis.

Integracija į esamą produktinę aplinką

Taikyti transfer learning tik eksperimentų aplinkoje nepakanka – svarbu, kaip šiuos modelius integruoti į realius produktus ir paslaugas. Čia svarbų vaidmenį atlieka tiek techninė architektūra, tiek procesai.

Modelio diegimas ir versijavimas

Adaptuojant esamus modelius verta iš anksto suplanuoti:

- Modelio versijavimą. Kiekvienas fine-tuning etapas turėtų turėti aiškų versijos numerį ir metaduomenis (mokymo duomenys, hiperparametrai, data).

- Grįžimo (rollback) strategiją. Jei nauja modelio versija pasirodys prastesnė, turite turėti galimybę greitai grįžti prie ankstesnės.

- Monitoringo sistemą. Svarbu stebėti produktyvinio modelio tikslumą, vėlavimą ir kitus KPI, kad laiku pastebėtumėte nukrypimus.

Duomenų srautas ir atnaujinimai

Transfer learning nereiškia vienkartinio modelio adaptavimo. Dažnai verta periodiškai kartoti fine-tuning, kai atsiranda naujų duomenų ar pasikeičia vartotojų elgsena.

- Sukurkite reguliarų retrain procesą, paremtą naujai surinktais pažymėtais duomenimis.

- Naudokite palaipsnį mokymąsi (angl. incremental learning), jei jūsų architektūra tai palaiko.

- Atsargiai tvarkykite koncepto dreifą (angl. concept drift), kai keičiasi duomenų pasiskirstymas.

Realūs verslo pritaikymo scenarijai

Transfer learning taikymas esamuose modeliuose nėra vien teorinė idėja – tai praktika, kurią sėkmingai naudoja daugybė įmonių ir organizacijų.

E. komercija ir rekomendacijos

Elektroninės prekybos platformos naudoja transfer learning tiek vaizdų, tiek teksto srityse:

- Automatizuotam produktų nuotraukų klasifikavimui ir moderavimui.

- Klientų atsiliepimų analizės sistemoms, nustatant sentimentą ir pagrindines temas.

- Paieškos ir rekomendavimo algoritmams, naudojant semantines reprezentacijas.

Finansai ir rizikos vertinimas

Finansų sektoriuje transfer learning naudojamas:

- Analizuojant sandorių srautus su anksčiau apmokytais anomalijų detekcijos modeliais.

- Apdorojant tekstinius duomenis (sutartis, ataskaitas, naujienas) su iš anksto apmokytais NLP modeliais.

- Laiko eilučių prognozėms, pernaudojant bendrus rinkų dinamikos modelius.

Medicinos diagnostika ir vaizdai

Medicinoje duomenų žymėjimas dažnai brangus ir ribotas, todėl transfer learning atlieka kritinį vaidmenį:

- Iš anksto apmokyti modeliai ant bendrų vaizdų pritaikomi rentgeno, MRT ar KT vaizdams.

- Dokumentacijos analizėje naudojami pritaikyti medicininiai BERT modeliai.

- Sumažinamos žymėtų duomenų sąnaudos ir paspartinamas naujų sprendimų diegimas.

Ateities kryptys: foundation modeliai ir multimodalumas

Transfer learning evoliucionuoja kartu su vadinamaisiais foundation modeliais – labai dideliais, universaliais modeliais, kurie tampa atspirties tašku daugeliui skirtingų užduočių. Dideli kalbos modeliai (LLM), multimodaliniai modeliai (tekstui, vaizdui, garsui kartu) – tai nauja transfer learning banga.

Ateityje vis dažniau ne tik perduosime žinias iš vienos užduoties į kitą, bet ir derinsime skirtingas modalumas, kad modeliai suprastų pasaulį panašiai kaip žmonės – matydami, girdėdami ir skaitydami tuo pačiu metu.

Išvados

Transfer learning pritaikymas esamuose modeliuose leidžia organizacijoms ir kūrėjams greitai perkelti pažangiausius dirbtinio intelekto pasiekimus į realius produktus. Vietoj brangaus ir ilgo modelių kūrimo nuo nulio, galima pasinaudoti jau sukauptomis žiniomis ir jas pritaikyti konkrečioms nišinėms problemoms.

Laikantis geriausių praktikų – teisingai pasirenkant bazinį modelį, atsakingai valdant fine-tuning procesą ir kuriant tvarią diegimo bei monitoringo infrastruktūrą – transfer learning tampa vienu efektyviausių būdų maksimaliai išnaudoti esamus DI modelius ir kurti konkurencingus, greitai adaptuojamus sprendimus.