Parameter-Efficient Fine-Tuning (PEFT): efektyvūs metodai dideliems kalbos modeliams

Išsamus gidas apie Parameter-Efficient Fine-Tuning (PEFT) metodus: LoRA, QLoRA, adapteriai, prompt tuning, jų privalumai, ribojimai ir praktiniai taikymo scenarijai.

Parameter-Efficient Fine-Tuning (PEFT) metodai tapo vienu svarbiausių įrankių dirbant su dideliais kalbos modeliais, nes leidžia juos pritaikyti naujoms užduotims nebereikalaujant milžiniškų skaičiavimo resursų ar viso modelio pertreniruotės [web:1][web:7]. Šis požiūris remiasi idėja, kad dauguma iš anksto išmokto modelio parametrų jau užkoduoja bendrą pasaulio ir kalbos žinojimą, todėl pritaikymui pakanka efektyviai koreguoti tik mažą parametrų dalį [web:3][web:5].

Kas yra Parameter-Efficient Fine-Tuning?

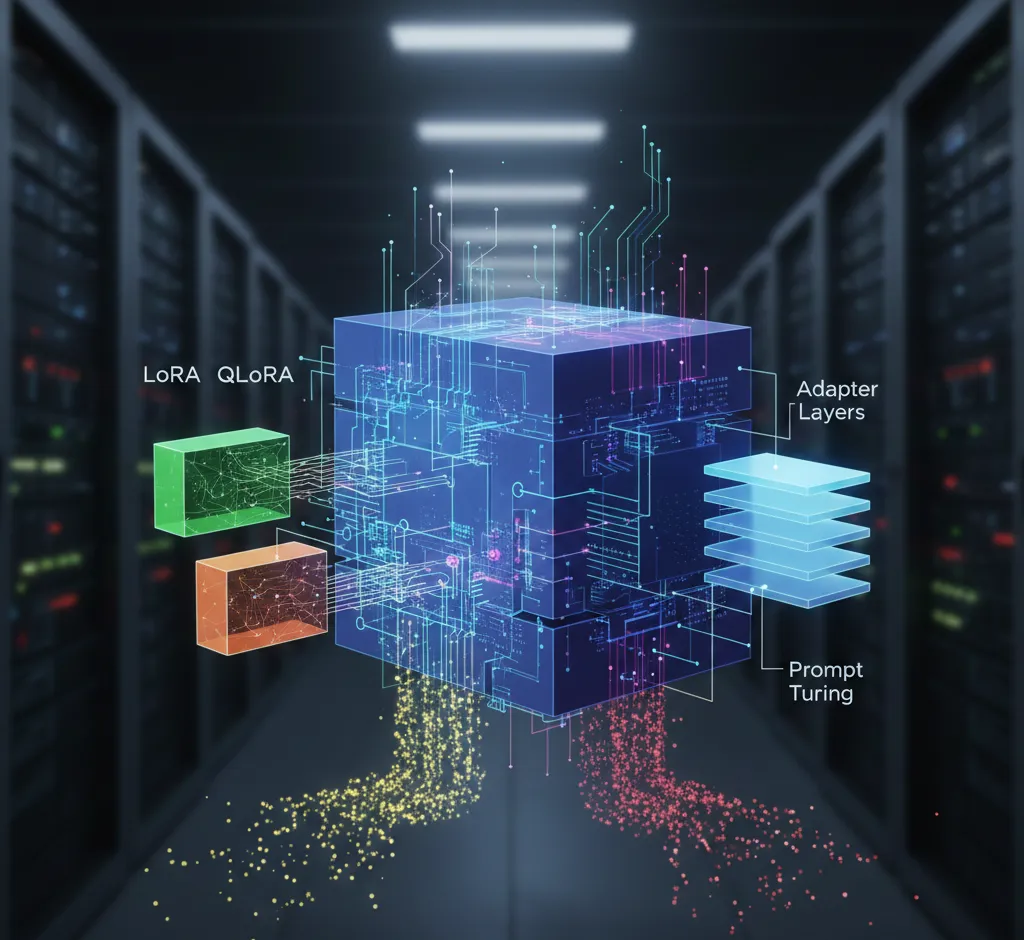

PEFT – tai metodų šeima, kurių tikslas yra pritaikyti iš anksto išmokytus didelius modelius naujoms užduotims atnaujinant tik mažą dalį parametrų arba pridedant lengvus papildomus modulius [web:1][web:7]. Vietoje to, kad būtų atnaujinami visi milijardai svorių, PEFT technikos dažniausiai užšaldo bazinį modelį ir treniruoja tik mažus adapterius ar žemos rangos projekcijas, taip reikšmingai sumažindamos treniruotės kainą [web:2][web:4].

Toks požiūris yra ypač svarbus praktikoje, nes visiškas didelių modelių derinimas reikalauja daug GPU atminties, ilgų treniruočių laikų ir didelių energijos kaštų [web:3][web:11]. Dėl PEFT organizacijos gali naudoti tuos pačius bazinius modelius daugeliui skirtingų užduočių, saugodamos tik mažus užduočiai specifinius svorių rinkinius, o ne visus modelio parametrus [web:2][web:4].

Pagrindiniai PEFT tikslai ir nauda

Vienas svarbiausių PEFT tikslų – sumažinti skaičiavimo ir saugojimo resursų poreikį, nepaukojant daug modelio tikslumo lyginant su pilnu fine-tuningu [web:2][web:5]. Kadangi treniruojama tik maža parametrų dalis, treniravimo procesas tampa greitesnis, o kiekvienai naujai užduočiai reikia vos kelių megabaitų papildomų svorių, o ne naujos daugiagigabaitinės modelio kopijos [web:2][web:4].

Kitas svarbus privalumas – išvengiama vadinamojo katastrofiško užmiršimo, kuris dažnai pasireiškia, kai tas pats modelis kelis kartus pilnai derinamas skirtingiems domenams [web:3][web:11]. Naudojant PEFT, bazinis modelis išlieka stabilus, o specifinis elgesys atskiroms užduotims įgyvendinamas per atskirus adapterius ar kitus lengvus modulius, kuriuos galima įjungti ar išjungti pagal poreikį [web:2][web:4].

PEFT veikimo principai

Tipinė PEFT schema prasideda nuo didelio iš anksto išmokyto modelio, kuris užrakinamas (užšaldomi svoriai), kad treniruotės metu nebūtų keičiamas [web:1][web:5]. Ant šio modelio sluoksnių uždedami papildomi moduliai arba parenkamos tik tam tikros parametrų grupės, kurios gali būti atnaujinamos, pavyzdžiui, mažos pridedamos projekcijos, adapterių sluoksniai ar prompt vektoriai [web:4][web:11].

Mokymo metu gradientai skaičiuojami visam tinklui, bet atnaujinami tik tie parametrai, kurie pažymėti kaip treniruojami, o visi kiti lieka pastovūs [web:1][web:5]. Tai leidžia išnaudoti visą bazinio modelio reprezentacinę galią, tuo pačiu sumažinant atminties naudojimą, nes nereikia saugoti visų sluoksnių gradientų ir momentų optimizatoriui [web:3][web:11].

LoRA: Low-Rank Adaptation

LoRA (Low-Rank Adaptation) yra viena populiariausių PEFT technikų, kuri svorių atnaujinimą modeliuoja kaip žemos rangos matricų sumažinimą [web:4][web:5]. Vietoje to, kad būtų atnaujinamas visas didelis svorių matricos blokas, LoRA prideda dvi mažas projekcijos matricas, kurių sandauga apytiksliai atkuria reikalingą pokytį, taip ženkliai mažindama treniruojamų parametrų skaičių [web:4][web:11].

Praktikoje LoRA leidžia pilnai suderinti net 10–70 mlrd. parametrų modelius viename ar keliuose GPU, nes atminties poreikis priklauso tik nuo mažų žemos rangos matričių [web:4][web:11]. Tyrimai rodo, kad tinkamai parinkus rango dydį ir sluoksnius, kuriems taikoma LoRA, galima pasiekti panašų ar net geresnį rezultatą nei pilnas fine-tuningas, ypač kai duomenų kiekis nėra labai didelis [web:3][web:11].

QLoRA: kvantizuota LoRA versija

QLoRA išplečia LoRA idėją, leisdama bazinį modelį laikyti kvantizuotoje (pavyzdžiui, 4 bitų) formoje, tuo metu treniruojant LoRA adapterius aukštesniu tikslumu [web:11]. Tokiu būdu dar labiau sumažinamas GPU atminties poreikis, nes didžioji dalis svorių saugoma stipriai suspaustame formate, o tik maža adapterių dalis išlieka pilno tikslumo [web:11][web:3].

QLoRA ypač tinkama scenarijams, kai reikalinga pritaikyti labai didelius modelius ribotų resursų aplinkoje, pavyzdžiui, viename vartotojiškame GPU arba debesijos instancuose su ribotu VRAM [web:11]. Nors kvantizacija teoriškai gali sumažinti tikslumą, empirinis vertinimas rodo, kad kruopščiai parinkus kvantizacijos schemą ir adapterių konfigūraciją galima išlaikyti rezultatą, artimą pilno tikslumo LoRA ar net pilnam fine-tuningui [web:3][web:11].

Adapterių sluoksniai

Adapteriai – tai nedideli papildomi sluoksniai, įterpiami į esamą modelio architektūrą, dažniausiai tarp transformerių blokų [web:4][web:1]. Bazinis modelis lieka užšaldytas, o adapterių sluoksniai treniruojami konkrečiai užduočiai, taip leidžiant modeliui pritaikyti savo reprezentacijas nekeičiant pagrindinių svorių [web:3][web:5].

Tokie sluoksniai paprastai turi daug mažiau parametrų nei pagrindiniai transformerių blokai, todėl jų mokymas yra santykinai pigus ir greitas [web:4]. Privalumas tas, kad galima sukurti daug skirtingų adapterių rinkinių tam pačiam modeliui ir perjungti juos dinamiškai, priklausomai nuo to, kokios užduoties šiuo metu reikia – nuo vertimo iki specializuoto domeno klausimų–atsakymų [web:2][web:4].

Prompt tuning ir prefix tuning

Prompt tuning ir prefix tuning metodai remiasi papildomų įvesčių vektorių arba pseudo-žetonų mokymu, kurie įterpiami į modelio įėjimą ar tarpinius sluoksnius [web:1][web:5]. Vietoje to, kad būtų keičiami pačių modelio sluoksnių svoriai, mokomi tik šie papildomi vektoriai, kurie veikia kaip teisingą elgesį iššaukiantys „raktai“ konkrečiai užduočiai [web:3][web:7].

Tokie metodai ypač patrauklūs, kai norima išlaikyti modelį kaip paslaugą ir nesikeičiančią bazinę architektūrą, o užduoties specifika užkoduojama tik per promptų parametrus [web:1][web:7]. Nors vien prompt tuning dažnai nusileidžia LoRA ar adapteriams labai sudėtingose užduotyse, jis pasižymi ypatingu paprastumu ir minimaliais saugojimo kaštais, nes pridedami tik keli tūkstančiai ar keliolika tūkstančių parametrų [web:3][web:5].

Kada rinktis PEFT vietoje pilno fine-tuningo?

PEFT labiausiai tinka tada, kai turimi riboti skaičiavimo resursai arba kai reikia pritaikyti tą patį bazinį modelį dešimtims ar šimtams skirtingų užduočių [web:2][web:4]. Tokiais atvejais pilnas fine-tuningas kiekvienai užduočiai būtų nepraktiškas tiek dėl treniravimo laiko, tiek dėl saugojimo – kiekvienam variantui reikėtų atskiro didelio modelio kontrolinio taško [web:4][web:11].

Taip pat PEFT ypač naudinga, kai duomenų kiekis yra ribotas ir norima išvengti modelio pertreniruotės ar bazinių žinių praradimo [web:3][web:5]. Kadangi bazinis modelis neužmiršta savo ankstesnių gebėjimų, galima sukurti labai specializuotus elgesio adapterius, išlaikant bendrą kalbos supratimą ir pasaulio žinias [web:3][web:7].

PEFT ribojimai ir kompromisai

Nors PEFT metodai labai efektyvūs, jie ne visada pasiekia identišką našumą, lyginant su kruopščiai atliktu pilnu fine-tuningu labai sudėtingiems ar labai naujiems domenams [web:3][web:11]. Kai kuriais atvejais, ypač jei reikia radikaliai pakeisti modelio elgesį ar dirbama su itin specifiniais duomenimis, gali prireikti daugiau treniruojamų parametrų arba hibridinių schemų, derinančių PEFT ir dalinį full-tuningą [web:3].

Kitas ribojimas – sudėtingesnis valdymas, kai vienam modeliui susikaupia dešimtys ar šimtai skirtingų adapterių ir LoRA konfigūracijų [web:4]. Tada reikia apgalvotos versijų ir priklausomybių valdymo strategijos, kad būtų aišku, kuris adapterių rinkinys naudojamas konkrečioje aplinkoje ar konkrečiam klientui [web:2].

PEFT taikymo sritys

PEFT taikomas ne tik kalbos modeliams, bet ir vaizdų, garso ir daugiamodalėms architektūroms, nes principas – treniruoti tik dalį parametrų – nepriklauso nuo duomenų tipo [web:2][web:5]. Pavyzdžiui, adapterių ar LoRA moduliai sėkmingai naudojami kompiuterinės regos modeliuose, stabilių difuzijos modelių personalizavimui ir kodų generavimo sistemoms [web:4][web:11].

Verslo aplinkoje PEFT leidžia įmonėms pritaikyti bendrus modelius specifiniam žargonui, produktams ar procesams, neatskleidžiant viso bazinio modelio ir nesukuriant sunkiai prižiūrimų milžiniškų modelio šakų [web:7][web:1]. Tai ypač aktualu debesijos paslaugose, kur bazinis modelis gali būti valdomas tiekėjo, o klientas valdo tik savo adapterių rinkinius [web:2][web:7].

Geriausios praktikos PEFT naudojimui

Renkantis PEFT metodą, svarbu atsižvelgti į užduoties sudėtingumą, turimų duomenų kiekį ir reikalaujamą našumą, nes skirtingos technikos (LoRA, QLoRA, adapteriai, prompt tuning) pasižymi skirtingu kompromisu tarp tikslumo ir resursų [web:3][web:11]. Dažnai rekomenduojama pradėti nuo LoRA ar QLoRA, nes jos siūlo gerą balansą tarp paprastumo, našumo ir resursų poreikio, o esant poreikiui derinti su adapteriais ar prompt tuning [web:4][web:5].

Taip pat naudinga standartizuoti adapterių ir konfigūracijų valdymą, pavyzdžiui, naudoti vieningą biblioteką ar modelių saugyklą, kurioje aiškiai žymimi naudojami PEFT metodai ir versijos [web:4]. Tokia praktika palengvina diegimą, palyginamąjį testavimą ir rizikos valdymą, kai tie patys modeliai naudojami gamybinėje aplinkoje skirtingiems projektams ar klientams [web:2][web:7].

PEFT ateitis

Augant modelių dydžiams ir daugėjant jų pritaikymo scenarijų, PEFT metodų svarba tik didės, nes jie leidžia demokratiškai naudoti didelius modelius platesniam kūrėjų ir organizacijų ratui [web:1][web:7]. Jau dabar kuriami hibridiniai metodai, kurie derina kvantizaciją, žemos rangos adaptacijas, adapterius ir išmanias treniruojamų parametrų parinkimo strategijas, siekiant dar geresnio efektyvumo ir stabilumo [web:3][web:11].

Tikėtina, kad ateityje PEFT taps numatytuoju standartu daugeliui pritaikymo scenarijų, o pilnas fine-tuning bus naudojamas tik išskirtiniais atvejais, kai būtina maksimaliai kontroliuoti visus modelio parametrus [web:2][web:4]. Tai reikš, jog dideli modeliai virs universalia baze, ant kurios bus sluoksniuojamos lengvos, užduočiai specifinės žinių ir elgesio adaptacijos, valdoma panašiai kaip įskiepių ekosistema programinėje įrangoje [web:7][web:1].