Large Language Models Scaling Laws: Kaip dydis keičia dirbtinį intelektą

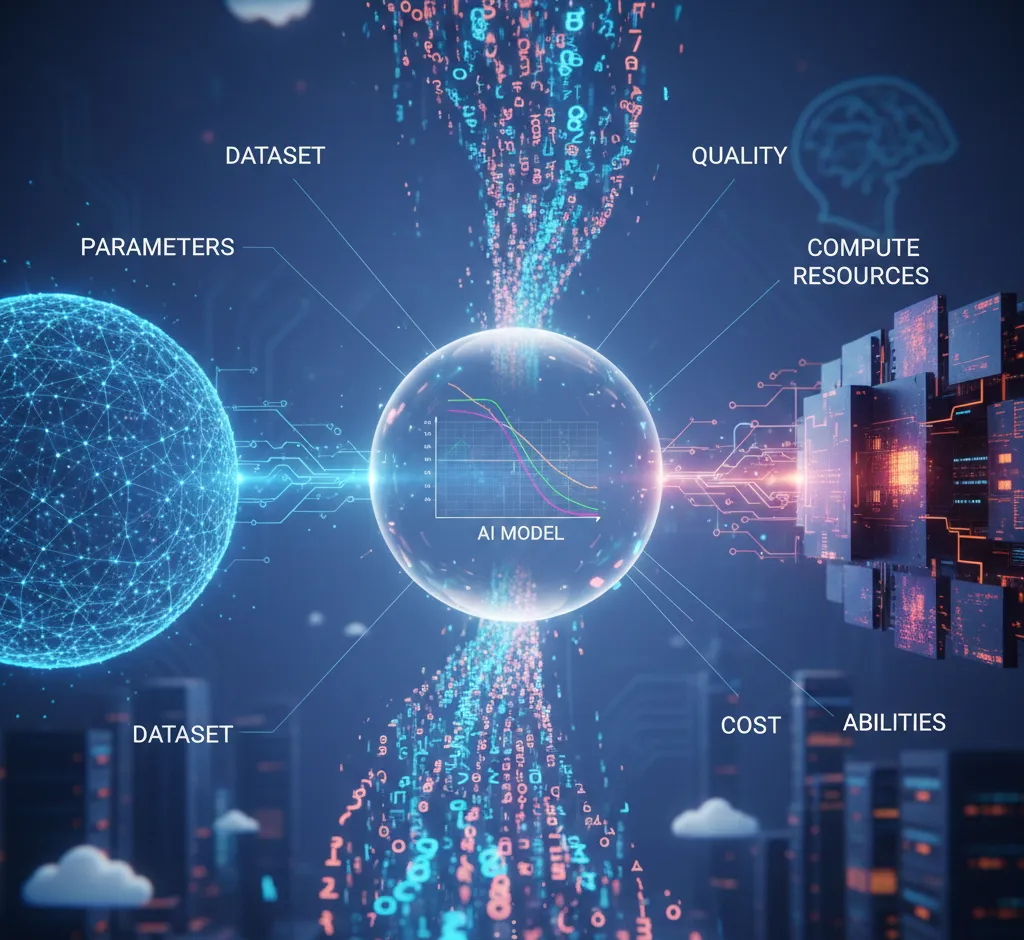

Sužinokite, kas yra Large Language Models scaling laws, kaip modelio dydis, duomenų kiekis ir skaičiavimo resursai lemia LLM kokybę, kainą ir gebėjimus, bei kaip praktiškai išnaudoti šiuos mastelio dėsnius versle.

Large Language Models (LLM) per pastaruosius kelerius metus iš nišinės technologijos virto pagrindine dirbtinio intelekto (DI) pažangos ašimi. Tokie modeliai kaip GPT, PaLM ar LLaMA demonstruoja vis sudėtingesnius gebėjimus: nuo teksto generavimo ir programavimo iki kompleksinių analizės užduočių. Tačiau už šių proveržių slypi ne tik architektūros triukai, bet ir gilesnis principas – scaling laws, arba mastelio dėsniai.

Scaling laws aprašo, kaip modelio kokybė ir gebėjimai keičiasi didinant modelio parametrų skaičių, duomenų kiekį ir skaičiavimo resursus. Suprasdamos šiuos dėsnius komandos gali efektyviau planuoti biudžetą, infrastruktūrą ir tyrimus, o verslai – geriau įsivertinti, kokio masto modeliai jiems iš tikrųjų reikalingi.

Kas yra scaling laws dideliems kalbos modeliams?

Scaling laws (mastelio dėsniai) – tai empiriškai nustatyti matematiniai ryšiai, rodantys, kaip klaida ar nuostolio funkcija mažėja, kai didiname:

- modelio dydį (parametrų skaičių),

- mokymo duomenų kiekį,

- skaičiavimo resursus (FLOPs, GPU valandas ir pan.).

Praktiškai tai reiškia, kad galima gana tiksliai prognozuoti, kiek pagerės modelio veikimas, jeigu investuosime X kartų daugiau resursų. Ankstyvi OpenAI, DeepMind ir kitų tyrėjų darbai parodė, kad klaida mažėja maždaug pagal galios dėsnį: didinant mastelį logaritminėje skalėje, kokybė stabiliai ir nuspėjamai gerėja.

Kodėl scaling laws tapo tokie svarbūs?

- Jie paverčia modelių kūrimą inžinerine, o ne tik eksperimentine disciplina.

- Leidžia prognozuoti DI pažangą remiantis resursų augimu.

- Padeda optimizuoti biudžetą – nebereikia aklai didinti modelio, jei trūksta duomenų ar skaičiavimo galios.

- Suteikia verslo argumentus investicijoms į DI infrastruktūrą.

Trijų dimensijų skalė: parametrai, duomenys ir skaičiavimas

Didelių kalbos modelių scaling laws dažniausiai analizuojami trimis pagrindinėmis dimensijomis:

1. Modelio dydis (parametrų skaičius)

Kuo daugiau parametrų turi modelis, tuo didesnį sudėtingumą jis gali užkoduoti. Praktikoje tai reiškia:

- geresnį konteksto supratimą,

- tikslesnę semantiką ir sintaksę,

- aukštesnio lygio samprotavimo gebėjimus.

Tačiau scaling laws rodo, kad vien modelio dydžio didinimas nėra optimalus, jei neauga duomenų kiekis. Per dideli modeliai su per mažai duomenų pertreniruojami ir nenaudoja savo potencialo.

2. Mokymo duomenų kiekis

Kalbos modeliai mokosi iš masyvių tekstinių korpusų: žiniasklaidos, knygų, dokumentacijos, kodo ir pan. Scaling laws rodo, kad:

- mažiems modeliams trūksta „talpos“ pilnai išnaudoti didelius duomenų rinkinius,

- dideliems modeliams, priešingai, dažnai trūksta kokybiškų duomenų,

- egzistuoja optimalus santykis tarp parametrų ir duomenų kiekio.

Jeigu parametrų daug, o duomenų mažai – modelis mokosi iš anksto turimos informacijos „per dažnai“, o bendras apibendrinimas prastėja. Todėl modernūs LLM siekia subalansuoti šias dvi dimensijas.

3. Skaičiavimo resursai (compute)

Trečioji dimensija – tai skaičiavimų kiekis, dažnai matuojamas FLOPs (floating point operations). Net jei turime pakankamai duomenų ir didelį modelį, nepakankamas mokymo laikas neleis pasiekti teorinio potencialo.

Scaling laws padeda atsakyti į klausimą: kiek skaičiavimo resursų būtina skirti, kad investicija į parametrų ir duomenų augimą atsipirktų kokybės prasme?

Galios dėsniai ir klaidų mažėjimas

Mastelio dėsniai dideliems kalbos modeliams dažnai aprašomi galios dėsniais: klaida mažėja maždaug kaip konstanta padalinta iš tam tikro resurso laipsnio. Praktikoje tai reiškia, kad:

- kiekvienas resursų padvigubinimas duoda vis mažesnį, bet vis tiek reikšmingą pagerėjimą,

- modelio kokybė gali būti ėję iš anksto nuspėjama,

- tam tikru masteliu atsiranda nauji gebėjimai – vadinamieji emergentiniai reiškiniai.

Įdomu tai, kad LLM elgesys ne visada gerėja tik „po truputį“. Tiriant scaling laws pastebėta, kad pasiekus tam tikrą dydį modeliai staiga išmoksta daryti tai, ko anksčiau visai nesugebėjo, pavyzdžiui:

- logiškai spręsti sudėtingas užduotis (multi-step reasoning),

- rašyti struktūruotą programinį kodą,

- vykdyti instrukcijas su kontekstu (in-context learning).

Optimalus balansas: kaip parinkti mastelį?

Verslui ar tyrimų komandai svarbiausias praktinis klausimas: kaip pasirinkti optimalų modelio mastelį? Scaling laws čia tampa strateginiu įrankiu.

Parametrai vs duomenys

Empiriškai pastebėta, kad egzistuoja „saldi zona“ (angl. sweet spot), kurioje:

- neperdėtai didelis modelis mokomas ant pakankamai daug ir įvairių duomenų,

- klaida mažėja arčiausiai teorinių scaling laws prognozių,

- kiekvienas papildomas GPU valandos vienetas duoda maksimalų rezultatą.

Per mažas modelis – neišnaudoja turimų duomenų, per didelis – beprasmiškai „švaisto“ skaičiavimo resursus, nes dalis parametrų lieka neoptimaliai išnaudoti.

Praktinis pavyzdys

Įsivaizduokime, kad turite ribotą biudžetą ir renkatės tarp dviejų strategijų:

- Mokyti 10 mlrd. parametrų modelį ant 500 mlrd. žodžių duomenų.

- Mokyti 30 mlrd. parametrų modelį ant 300 mlrd. žodžių duomenų.

Remiantis scaling laws, labai tikėtina, kad pirmas variantas bus efektyvesnis, nes duomenų kiekis geriau atitiks modelio dydį, o klaida mažės arčiau teorinės kreivės. Tai yra būtent ta įžvalga, kurią scaling laws suteikia be reikalavimo viską išbandyti praktiškai.

Inference ir eksploatavimo mastelio iššūkiai

Nors scaling laws daugiausia kalba apie mokymą, realiame pasaulyje dideli kalbos modeliai turi būti efektyvūs ir panaudojimo (inference) metu. Kuo modelis didesnis, tuo:

- didesnė atsakymo generavimo kaina,

- ilgesnis atsakymo vėlavimas (latency),

- didesnės debesijos išlaidos.

Todėl atsiranda praktinė dilema: nors scaling laws rodo, kad „didesnis yra geriau“, verslui dažnai reikia subalansuoto modelio, kuris būtų pakankamai protingas, bet ne per brangus naudoti milijonams užklausų per dieną.

Modelių kompaktinimas

Čia į sceną žengia tokios technikos kaip:

- kvantizacija – mažesnio tikslumo skaičių naudojimas,

- distiliacija – „mokytojo“ modelio žinių perkėlimas į mažesnį „mokinio“ modelį,

- parametrų atjungimas (pruning) – nereikšmingų ryšių pašalinimas.

Šios technikos leidžia išlaikyti dalį scaling laws suteiktų privalumų, bet sumažinti realias eksploatavimo sąnaudas. Taip sukuriamas balansas tarp teorinių mastelio dėsnio galimybių ir praktinių verslo poreikių.

Emergentiniai gebėjimai: kada atsiranda „magija“?

Viena įdomiausių scaling laws pasekmių – emergentiniai gebėjimai. Tai reiškiniai, kai pasiekus tam tikrą modelio dydį ar mokymo mastą:

- atsiranda naujų, anksčiau nepasireiškusių savybių,

- modelis pradeda spręsti visiškai naujo pobūdžio užduotis,

- pagerėjimas atrodo „diskretus“, o ne tolygus.

Pavyzdžiui, mažesni modeliai gali:

- gerai užpildyti tekstą,

- atsakyti į paprastus klausimus,

- generuoti paprastus kodo fragmentus.

Tačiau tik pasiekus šimtų milijardų parametrų mastą atsiranda gebėjimai:

- struktūruotai samprotauti keliais žingsniais,

- mokytis iš kelių pavyzdžių pokalbio metu (few-shot, in-context learning),

- prisitaikyti prie vartotojo stilistikos spontaniškai.

Šie emergentiniai reiškiniai rodo, kad scaling laws yra ne tik apie „mažesnę klaidą“, bet ir apie kokybinį elgesio lūžį. Tai viena iš priežasčių, kodėl tiek daug dėmesio šiandien skiriama superdidelių LLM kūrimui.

Ekonominiai scaling laws aspektai

Didinant modelių mastelį, svarbūs ne tik techniniai, bet ir ekonominiai mastelio dėsniai. Kiekvienas papildomas parametrų, duomenų ir skaičiavimo vienetas turi savo kainą. Todėl atsiranda keli praktiniai klausimai:

- kiek kainuos pasiekti tam tikrą kokybės lygį?

- ar verta kurti savo LLM, ar naudoti jau egzistuojančius modelius kaip paslaugą?

- kiek kainuos palaikyti modelį produkcijoje?

Scaling laws leidžia iš anksto įvertinti, ar, pavyzdžiui, kokybės pagerėjimas 5–10 % yra ekonomiškai pateisinamas, jei tam reikia kelis kartus padidinti mokymo biudžetą. Daugeliu atvejų verslui pakanka gerai sukalibruoto vidutinio dydžio modelio, pritaikyto konkrečiai nišai ir duomenims, užuot siekus absoliutaus SOTA (state of the art) rezultato.

Scaling laws ir saugumas

Didėjant modelių mastui, svarbus tampa ir saugumo bei etikos aspektas. Galingesni modeliai:

- gali kurti labiau įtikinamą dezinformaciją,

- geriau apeina paviršutiniškas filtravimo taisykles,

- gali būti panaudoti kenksmingoms užduotims, jei nėra tinkamai prižiūrimi.

Scaling laws leidžia prognozuoti ne tik naudingus gebėjimus, bet ir potencialias rizikas. Kuo modelis galingesnis, tuo labiau reikia:

- griežtesnio saugojimo ir prieigos valdymo,

- aiškių naudojimo politikų,

- nuolatinio monitoringo ir audito.

Taigi scaling laws yra tiesiogiai susiję su atsakingo DI kūrimu: organizacijos turi vertinti ne tik potencialą, bet ir rizikų „masto“ augimą.

Kas toliau? Naujos scaling kryptys

Nors klasikiniai scaling laws daugiausia orientavosi į parametrus, duomenis ir compute, šiandien atsiranda naujų mastelio dimensijų:

- multimodalumas – modeliai, dirbantys ne tik su tekstu, bet ir su vaizdais, garsu, video,

- ilgesnis kontekstas – tūkstančių ar net milijonų žodžių langai,

- adapteriai ir LoRA – parametrų mastelio pritaikymas konkrečioms užduotims be pilno pertreniruojamo modelio.

Ateityje scaling laws tikėtina apims ne tik „dydį“, bet ir struktūrą: kaip architektūros pokyčiai, atminties moduliai, išorinės duomenų bazės ir įrankiai veikia bendrą modelio elgesį didėjant mastui.

Kaip praktikoje išnaudoti scaling laws?

Jei esate verslo atstovas, technologijų vadovas ar tyrėjas, norintis praktiškai išnaudoti scaling laws, verta laikytis kelių principų.

1. Aiškiai apibrėžkite tikslą

Pirmiausia nuspręskite, ką norite pasiekti:

- geresnę teksto generavimo kokybę?

- tikslesnius atsakymus į nišinius klausimus?

- greitesnį ir pigesnį realiojo laiko atsakymų generavimą?

Skirtingi tikslai gali reikšti skirtingą optimalų mastelio tašką.

2. Pasverkite savo resursus

Įvertinkite:

- kiek turite kokybiškų duomenų (ypač lietuvių ar kitomis nišinėmis kalbomis),

- kokį biudžetą galite skirti mokymui ir eksploatavimui,

- ar turite DI inžinierių komandą, galinčią prižiūrėti modelius.

Ši analizė padės suprasti, ar geriau:

- kurti savo modelį nuo nulio,

- finetune'inti esamą atvirą modelį,

- naudotis komerciniais API sprendimais.

3. Remkitės egzistuojančiais scaling laws tyrimais

Vietoje to, kad „šautumėte į tamsą“, naudokite publikuotus scaling laws rezultatus:

- įvertinkite, kokio dydžio modeliai atnešė jums panašiose užduotyse geriausią rezultatą,

- numatykite klaidos mažėjimo kreivę, jei dvigubinsite ar trigubinsite resursus,

- planuokite ilgalaikę DI strategiją per 2–3 metus į priekį.

Išvados: ką duoda scaling laws supratimas?

Scaling laws dideliems kalbos modeliams iš esmės pakeitė, kaip suprantame dirbtinį intelektą. Jie parodė, kad:

- modelių gebėjimai nuspėjamai gerėja didinant parametrų, duomenų ir skaičiavimo mastą,

- egzistuoja optimumo taškai, kuriuos galima apskaičiuoti, o ne surasti atsitiktinai,

- didesni modeliai ne tik mažina klaidą, bet ir atskleidžia kokybiškai naujus gebėjimus,

- ekonominiai ir saugumo aspektai tampa ne mažiau svarbūs nei techniniai.

Organizacijoms, kurios jau šiandien investuoja į dirbtinį intelektą, scaling laws suteikia strateginį kompasą: jie padeda nuspręsti, kiek „didelio“ DI iš tikrųjų reikia, kad būtų pasiektas maksimalus verslo ir technologinis efektas.

Galiausiai, supratimas apie scaling laws leidžia ne tik sekti DI revoliuciją, bet ir ją formuoti – priimant pagrįstus sprendimus, kur ir kaip investuoti į didelius kalbos modelius, kad jie ne tik demonstruotų įspūdingas galimybes, bet ir kurtų realią, apčiuopiamą vertę.