Kaip mokomi multimodaliniai modeliai: CLIP architektūra ir praktinis pritaikymas

Išsamus multimodalinių modelių ir CLIP architektūros paaiškinimas: kaip jie mokomi, kokių duomenų reikia, kokie iššūkiai kyla ir kaip CLIP taikomas paieškai, rekomendacijoms bei turinio analizei.

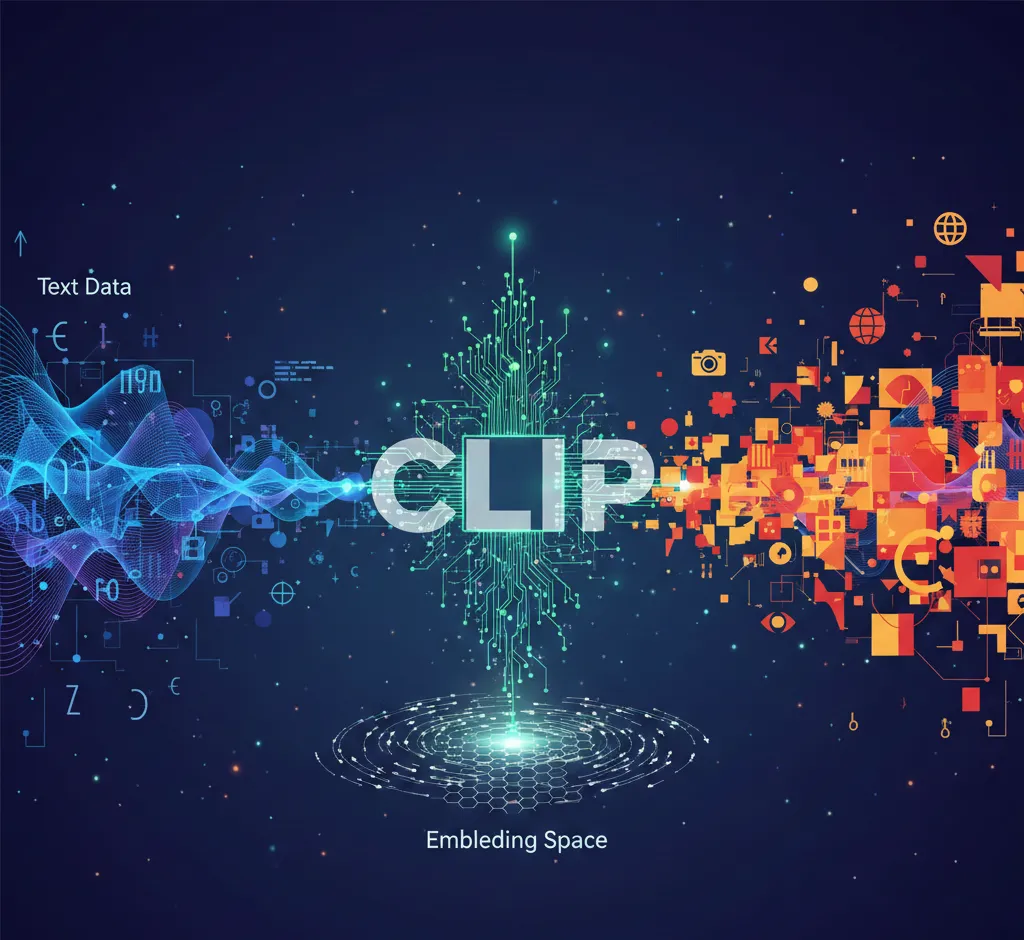

Multimodaliniai modeliai šiandien yra viena sparčiausiai augančių dirbtinio intelekto sričių. Jie geba suprasti ir apdoroti skirtingų tipų duomenis – tekstą, vaizdus, garsą ar net video – vieningoje reprezentacijų erdvėje. Vienas žinomiausių ir plačiausiai naudojamų multimodalinių modelių yra CLIP (Contrastive Language–Image Pre-training), sukurtas „OpenAI“. Šis modelis atvėrė kelią modernesnėms paieškos, rekomendacijų ir turinio analizės sistemoms, kurios gali suprasti, ką vaizdas „reiškia“ žmogiškąja kalba.

Šiame straipsnyje nuosekliai paaiškinsime, kaip veikia multimodaliniai modeliai, kuo CLIP išsiskiria iš kitų metodų, kokie yra jo mokymo principai, reikalavimai ir praktiniai pritaikymo būdai. Taip pat aptarsime, su kokiais iššūkiais susiduriama mokant tokius modelius ir kaip juos galima spręsti.

Kas yra multimodaliniai modeliai?

Tradiciniai mašininio mokymosi modeliai dažniausiai dirbo su viena duomenų rūšimi: tekstu, vaizdais arba garsu. Multimodaliniai modeliai sujungia kelias modalumas ir mokosi bendros reprezentacijos. Tai reiškia, kad modelis gali „susieti“ tekstą su vaizdu, garsą su subtitrais ar video su aprašymu.

Pavyzdžiui, multimodalinis modelis gali:

- Rasti vaizdus pagal natūralios kalbos užklausą (pvz., „katinas ant raudonos sofos“).

- Generuoti paveikslėlio aprašymą tekstu.

- Įvertinti, ar tekstinis aprašymas atitinka pateiktą vaizdą.

- Naudoti vizualinę informaciją geresniam teksto supratimui ir atvirkščiai.

CLIP yra būtent toks modelis, kuris sieja dvi modalumas – tekstą ir vaizdus – ir išmoksta juos atvaizduoti bendroje vektorinėje erdvėje.

CLIP modelio idėja ir esmė

CLIP pavadinimas nusako pagrindinę idėją – tai kontrastinis (angl. contrastive) tekstų ir vaizdų išankstinis apmokymas. Užuot mokius modelį tiesiogiai klasifikuoti vaizdus į fiksuotas klases, CLIP mokomas susieti laisvos formos tekstinius aprašus su atitinkamais vaizdais. Tai suteikia modeliu didelį lankstumą ir leidžia jam pritaikyti žinias naujose srityse be papildomo mokymo.

CLIP tikslas paprastas: kai pateikiamas vaizdas ir keletas tekstinių aprašymų, modelis turi didžiausią panašumą priskirti teisingam aprašymui ir mažesnį – neteisingiems. Tokiu būdu modelis palaipsniui išmoksta:

- Atpažinti objektus ir jų kontekstą vaizduose.

- Suprasti, kaip natūralios kalbos frazės aprašo vizualinę informaciją.

- Kurti bendrą semantinę erdvę, kurioje tekstas ir vaizdas tampa palyginami.

CLIP architektūra: du atskiri enkoderiai

CLIP sudarytas iš dviejų pagrindinių dalių – vaizdo enkoderio ir teksto enkoderio. Abu jie paverčia įvestį į vektorius (embeddingus), kuriuos galima tiesiogiai lyginti tarpusavyje.

Vaizdo enkoderis

Vaizdo enkoderis dažniausiai realizuojamas naudojant:

- Konvoliucinius neuroninius tinklus (CNN), pavyzdžiui, ResNet architektūrą.

- Arba Vision Transformer (ViT) architektūrą, kuri vaizdą suskaido į „paveiksliuko žodžius“ (patches) ir apdoroja juos transformerių blokais.

Modelis priima normalizuotą vaizdą, apdoroja jį per kelis sluoksnius ir galiausiai išveda fiksuoto ilgio vektorių, pavyzdžiui, 512 ar 768 dimensijų. Šis vektorius tampa vaizdo semantiniu atvaizdu, kurį galima lyginti su teksto vektoriumi.

Teksto enkoderis

Teksto enkoderis paprastai realizuotas kaip transformerių pagrindu sukurtas kalbos modelis, panašus į BERT ar GPT encoder dalį. Tekstas yra:

- Tokenizuojamas į atskirus žodžius ar sub-žodžius.

- Perduodamas per keliolika transformerių sluoksnių.

- Suglaudinamas į vieną vektorių, atspindintį visos eilutės prasmę.

Gautas vektorius yra tos pačios dimensijos kaip ir vaizdo vektorius, kad juos būtų galima tiesiogiai lyginti, pavyzdžiui, naudojant kosinį panašumą.

Kontrastinis mokymas: kaip CLIP mokosi

CLIP mokymo esmė – kontrastinis tikslas. Vietoje klasifikavimo į kategorijas, modelis mokomas didinti panašumą tarp teisingų vaizdo–teksto porų ir mažinti panašumą tarp neteisingų porų.

Mokymo duomenys

CLIP mokymui naudojami didžiuliai duomenų rinkiniai, sudaryti iš:

- Vaizdo.

- Jį lydinčio teksto – tai gali būti pavadinimas, aprašymas, antraštė, alt atributas ir pan.

Paprastai kalbame apie šimtus milijonų vaizdo–teksto porų, surinktų iš interneto. Tokie duomenys atspindi labai įvairias temas, stilius ir kontekstus, todėl modelis įgauna "bendrą pasaulio supratimą".

Kontrastinė praradimo funkcija

Mokymo metu:

- Kiekviena vaizdo–teksto pora praeina per savo enkoderius ir virsta dviem vektoriais.

- Skaičiuojamas panašumas tarp visų vaizdų vektorių ir visų tekstų vektorių mini-partijoje.

- Modelis baudžiamas, jei teisingos poros panašumas yra mažesnis nei neteisingų.

Tipiškai naudojama InfoNCE tipo praradimo funkcija, kur kiekvienam vaizdui teisingas tekstas turi turėti didžiausią panašumą iš visų tekstų partijoje. Tas pats taikoma ir atvirkščiai – tekstui teisingas vaizdas turi būti panašiausias. Taip modelis nuolat stumdo vektorius bendroje erdvėje: artina teisingas poras ir tolina neteisingas.

CLIP mokymo procesas praktikoje

Norint apmokyti CLIP tipo modelį nuo nulio, reikia ne tik daug duomenų, bet ir didelių skaičiavimo resursų. Vis dėlto, praktikoje dažnai pasirenkamas fine-tuning arba adapterių mokymas ant jau paruošto CLIP modelio pagrindo.

Pagrindiniai žingsniai mokant CLIP

Bendras procesas atrodytų taip:

- Duomenų surinkimas. Surenkamos vaizdo–teksto poros iš pasirinktos domeno srities (pvz., e. komercija, medicina, gamyba).

- Duomenų valymas. Pašalinamas nekokybiškas turinys, dublikatai, klaidingi ar labai trumpi aprašymai.

- Duomenų žymėjimas (jei reikia). Kartais prireikia rankinio patikslinimo, kad tekstas tiksliai atitiktų vaizdą.

- Architektūros pasirinkimas. Nusprendžiama, kokio dydžio vaizdo ir teksto enkoderiai bus naudojami, kokios dimensijos embeddingai.

- Mokymo konfigūracija. Nustatomas partijos dydis, mokymosi greitis, optimizatorius, reguliavimo metodai (dropout, weight decay).

- Mokymas. Modelis treniruojamas keliomis ar keliolika epochų, stebint praradimo funkcijos mažėjimą ir validacijos rodiklius.

- Vertinimas. Tikrinama, kaip modelis atlieka užduotis: vaizdų paieška pagal tekstą, tekstų paieška pagal vaizdą, atitikimo vertinimas.

Fine-tuning vietoje mokymo nuo nulio

Daugeliui įmonių ir projektų nereikia mokyti CLIP nuo nulio. Užtenka paimti jau apmokytą modelį ir:

- Pakoreguoti jį savo domenui – apmokyti kelis paskutinius sluoksnius ant specializuotų duomenų.

- Arba mokyti atskirą klasifikatorių ant CLIP embeddingų, kurie išgaunami iš bazinio modelio.

Toks požiūris leidžia pasiekti labai gerus rezultatus su santykinai nedideliu duomenų ir resursų kiekiu, pasinaudojant didelio masto išankstiniu mokymu.

Duomenų kokybė ir šališkumai

Nors dideli duomenų rinkiniai yra CLIP sėkmės priežastis, jie taip pat atneša rizikų. Interneto duomenyse gausu šališkumų, stereotipų, nekorektiško turinio ir netikslių aprašymų. Modelis išmoksta ne tik naudingo semantinio ryšio, bet ir nepageidaujamų asociacijų.

Tipinės problemos:

- Kultūriniai šališkumai – tam tikros tautybės ar profesijos gali būti reprezentuojamos stereotipiškai.

- Lyčių šališkumas – modelis gali susieti „programuotoją“ su vyrais, o „slaugytoją“ – su moterimis.

- Netikslūs aprašymai – automatiškai generuoti ar naudotojų sukurti tekstai gali klaidinti modelį.

Kuriant produkcinį sprendimą, būtina:

- Atlikti šališkumo auditą – testuoti modelį įvairiuose scenarijuose.

- Naudoti filtrus ir saugumo sluoksnius, ribojančius netinkamą turinį.

- Nuolat monitorinti modelio elgesį realiame naudojime.

CLIP praktiniai pritaikymai

CLIP ir CLIP tipo modeliai šiandien plačiai naudojami tiek moksliniuose, tiek komerciniuose projektuose. Štai keletas populiariausių pritaikymų:

Paieška pagal natūralų tekstą

Viena iš paprasčiausių ir galingiausių CLIP funkcijų – vaizdų paieška pagal aprašymą. Vietoj sudėtingų filtrų ar rankinių žymų, naudotojas gali įvesti laisvos formos užklausą, pavyzdžiui:

- „Besileidžianti saulė virš kalnų“.

- „Minimalistinis skandinaviško stiliaus svetainės interjeras“.

- „Raudonas sportinis automobilis naktiniame mieste“.

Sistema paverčia užklausą vektoriumi, palygina jį su visų duomenų bazės vaizdų vektoriais ir grąžina labiausiai panašius. Taip galima kurti modernias e. komercijos paieškas, nuotraukų archyvus ar skelbimų platformas.

Rekomendacijų sistemos

CLIP embeddingai gali būti naudojami kaip funkcijų erdvė rekomendacijų sistemoms. Pavyzdžiui, jeigu naudotojui patiko tam tikri produktų vaizdai, sistema gali:

- Surasti vizualiai ir semantiškai panašius produktus.

- Derinti vizualinę ir tekstinę informaciją individualizuotoms rekomendacijoms.

Taip gaunamos multimodalinės rekomendacijos, kurios daugelį atvejų pralenkia vien tik teksto arba vien tik vaizdo pagrindu veikiančias sistemas.

Turinio moderacija ir filtravimas

Naudojant CLIP, galima kurti sistemas, kurios automatiškai vertina, ar vaizdas atitinka tam tikras taisykles ar gaires. Pavyzdžiui:

- Atpažinti netinkamą ar žalingą turinį.

- Filtruoti logotipus, prekės ženklus ar jautrius simbolius.

- Žymėti turinį, kuriam reikia žmogaus peržiūros.

Nors CLIP nėra pilnas saugumo sprendimas, jis gali tapti svarbiu pirmo filtro komponentu, palengvinančiu moderatorių darbą.

Generatyviniai modeliai ir CLIP

CLIP taip pat dažnai naudojamas kartu su generatyviniais modeliais, tokiais kaip difuziniai vaizdų generatoriai. Čia CLIP vektoriai padeda nukreipti modelį taip, kad sugeneruotas vaizdas atitiktų tekstinę užklausą. Tai leidžia kurti galingus tekstą į vaizdą (text-to-image) sprendimus: iliustracijų generavimą, dizaino prototipus, reklamos vizualus ir kt.

Modelio diegimas produkcijoje

Norint CLIP ar panašų multimodalinį modelį naudoti produkcinėje aplinkoje, svarbu atkreipti dėmesį į kelis techninius ir organizacinius aspektus.

Mastelis ir našumas

CLIP enkoderiai yra pakankamai galingi modeliai, todėl:

- Dažnai naudojami GPU ar specializuoti akseleratoriai.

- Embeddingai iš anksto apskaičiuojami ir indeksuojami (pvz., naudojant FAISS ar kitas vektorių duomenų bazes).

- Online režimu iš naujo skaičiuojami tik nauji arba labai reti užklausų embeddingai.

Toks požiūris leidžia užtikrinti greitą paiešką ir didelį užklausų skaičių per sekundę, net jei duomenų bazėje yra milijonai vaizdų ar tekstų.

Saugumas ir privatumas

Dirbant su multimodaliniais modeliais, ypač jei apdorojami naudotojų įkelti vaizdai, būtina užtikrinti:

- Privatumo atitiktį (pvz., GDPR) – aiškiai informuoti naudotojus apie duomenų naudojimą.

- Saugų saugojimą – šifruoti jautrius duomenis, riboti prieigą.

- Modelio atnaujinimą – reguliariai tikrinti ir gerinti modelio elgesį, ypač su jautriu turiniu.

Stebėsena ir A/B testavimas

Įdiegus CLIP pagrindu veikiančią sistemą, rekomenduojama:

- Nuolat rinkti naudotojų grįžtamąjį ryšį ir sąveikos duomenis.

- Atlikti A/B testus, lyginant skirtingas architektūras ar parametrus.

- Kurti monitoringo paneles, stebinčias kokybės rodiklius, atsako laiką ir klaidų dažnį.

Multimodalinių modelių ateitis

CLIP buvo vienas iš pirmųjų modelių, parodžiusių, kaip efektyviai galima susieti tekstą ir vaizdus vienoje erdvėje be tiesioginio žymėjimo į fiksuotas klases. Tačiau ši sritis sparčiai vystosi. Nauji modeliai siekia:

- Apjungti daugiau modalumų – tekstą, vaizdą, garsą, video, sensorių duomenis.

- Gerinti kontekstinį supratimą – suvokti ne tik vieną kadrą, bet ir visą situaciją, istoriją ar scenarijų.

- Mažinti šališkumus ir klaidas, užtikrinant teisingesnį elgesį skirtingose kultūrose ir srityse.

Praktikoje tai reikš dar tikslesnes paieškos sistemas, gudresnes rekomendacijas, interaktyvius asistentus, gebančius matyti ir girdėti, bei naujas kūrybines priemones, kuriose žmogaus idėjas įgyvendins dirbtinis intelektas.

Išvados

Multimodaliniai modeliai, tokie kaip CLIP, žymi svarbų etapą dirbtinio intelekto evoliucijoje. Užuot dirbę su izoliuotomis duomenų rūšimis, jie mokosi bendros semantinės erdvės, kurioje tekstas ir vaizdas tampa tiesiogiai palyginami. Kontrastinis mokymas leidžia efektyviai išnaudoti didžiulius interneto duomenų kiekius, o išankstinis mokymas suteikia galingą pagrindą daugybei praktinių sprendimų.

Norint sėkmingai pritaikyti CLIP tipo modelius savo projekte, svarbu suprasti ne tik techninę architektūrą, bet ir duomenų kokybės, šališkumų, našumo ir saugumo aspektus. Tinkamai apsvarsčius šiuos veiksnius, multimodaliniai modeliai gali tapti esminiu konkurenciniu pranašumu – tiek kuriant išmanesnes paieškos ir rekomendacijų sistemas, tiek automatizuojant turinio analizę ar kuriant naujas skaitmenines patirtis.