Daugelio Agentų Mokymasis Stiprinant (MARL): Dirbtinio Intelekto Ateitis Kelių Žaidėjų Aplinkose

Išsamus straipsnis apie Multi-agent Reinforcement Learning (MARL) principus, pagrindinius metodus (CTDE, VDN, QMIX) ir realaus pasaulio taikymus autonominėse sistemose, robotikoje ir finansuose. Sužinokite apie DI ateitį kelių agentų aplinkose.

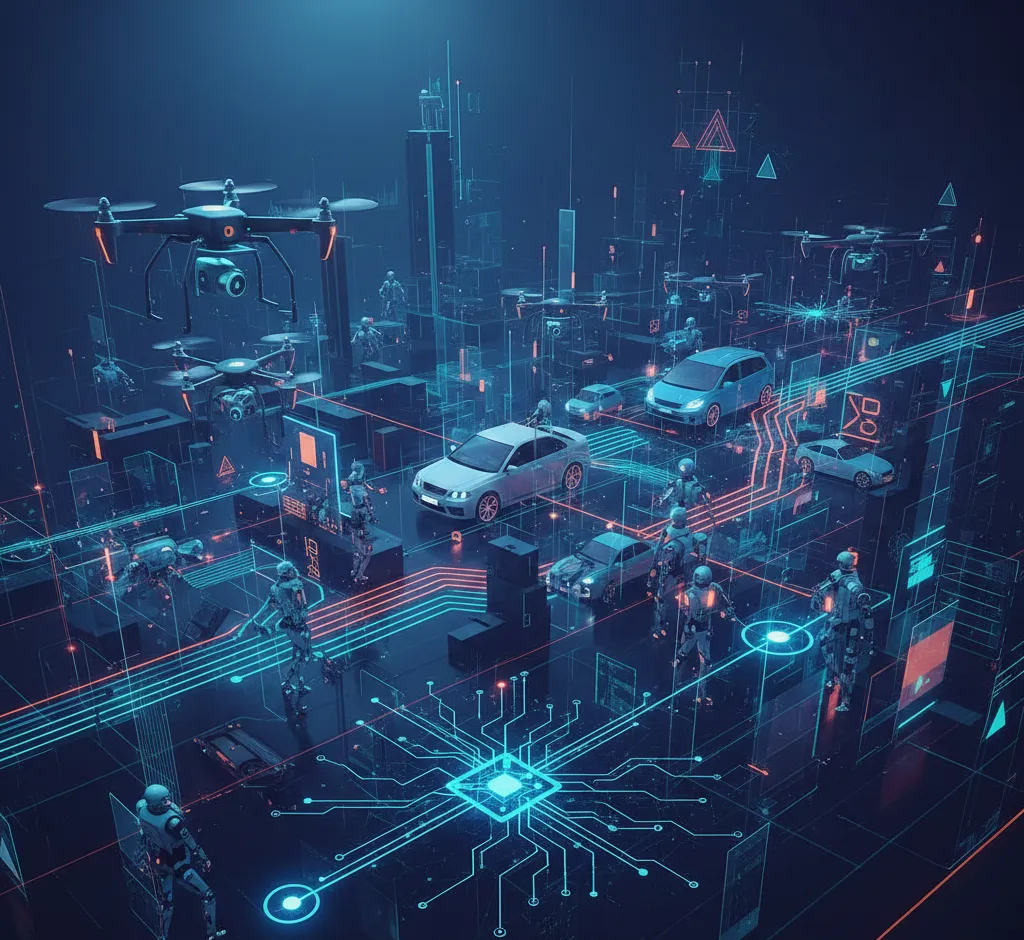

Dirbtinio intelekto (DI) pažanga per pastarąjį dešimtmetį buvo nuostabi, ypač vieno agento mokymosi stiprinant (RL) srityje. Tačiau realiame pasaulyje problemos retai sprendžiamos izoliuotai. Dažniausiai aplinkoje veikia daugybė agentų, kurių veiksmai daro įtaką vienas kito rezultatams. Čia į sceną žengia **Daugelio Agentų Mokymasis Stiprinant (Multi-agent Reinforcement Learning – MARL)** – sritis, tirianti, kaip keli agentai gali mokytis optimalių strategijų sąveikaudami bendroje aplinkoje.

Kas yra MARL? Pagrindai ir Skirtumai nuo Vieno Agento RL

Mokymasis stiprinant (RL) remiasi agento ir aplinkos sąveika, kur agentas mokosi maksimizuoti atlygį atlikdamas veiksmus ir gaudamas grįžtamąjį ryšį. Vieno agento atveju, aplinka yra statiškai apibrėžta. Tačiau MARL atveju, kiti agentai tampa neatsiejama ir kintančia aplinkos dalimi. Šis skirtumas sukuria esminių iššūkių:

- Nestacionari Aplinka: Kiekvienam agentui, kitų agentų veiksmai keičia aplinkos dinamiką. Strategijos, optimalios vienu momentu, gali tapti netinkamos, kai kiti agentai atnaujina savo strategijas.

- Kredito Priskyrimo Problema: Sunku nustatyti, kurio agento veiksmai lėmė bendrą sėkmę (bendradarbiaujančiose sistemose) arba nesėkmę (konkurencinėse sistemose).

- Didesnė Būsenų ir Veiksmų Erdvė: Bendra sistemos būsenų erdvė ir veiksmų erdvė eksponentiškai didėja su agentų skaičiumi.

- Bendradarbiavimo Aplinkos: Visi agentai siekia bendro tikslo ir dalinasi tuo pačiu atlygio signalu (pvz., eismo valdymas, komandinis robotikos darbas).

- Konkurencinės Aplinkos: Agentai turi priešingus tikslus, vieno agento laimėjimas yra kito pralaimėjimas (pvz., žaidimai „Go“, „Pokeris“).

- Mišrios Aplinkos: Agentai turi ir bendrų, ir individualių tikslų (pvz., ekonominiai modeliai, derybos).

Pagrindinės MARL Paradigmos ir Metodai

MARL tyrimai dažniausiai skirstomi į tris pagrindines paradigmas, siekiant spręsti nestacionarumo ir kredito priskyrimo problemas:

1. Centrinis Mokymas su Decentralizuotu Vykdymu (CTDE)

Tai populiariausias ir sėkmingiausias metodas bendradarbiavimo MARL srityje. **CTDE** idėja paprasta: mokymosi metu visi agentai turi prieigą prie visos sistemos būsenos informacijos. Tai leidžia algoritmui koordinuoti agentų veiksmus ir supaprastina kredito priskyrimo problemą. Tačiau vykdymo metu (kai sistema veikia realiuoju laiku), kiekvienas agentas priima sprendimus tik pagal savo vietinę stebėjimo informaciją.

Populiarūs CTDE modeliai:

- VDN (Value Decomposition Networks): Dekonstruoja bendrą atlygio funkciją į individualias agentų atlygio funkcijas.

- QMIX: Naudoja derinimo tinklą (mixing network), kuris užtikrina, kad bendra Q-funkcija būtų monotoninė atskirų agentų Q-funkcijų atžvilgiu, taip supaprastinant optimizavimą.

2. Konkurenciniai Metodai (Adversarial Methods)

Konkurenciniuose žaidimuose (pvz., nulinės sumos žaidimuose), pagrindinis dėmesys skiriamas rasti **Nasho pusiausvyrą** arba bent jau strategiją, kuri yra stabili prieš optimalų oponento atsaką. Vienas žymiausių pavyzdžių yra dirbtinio intelekto agentai, pasiekę meistriškumo lygį žaidimuose kaip „Pokeris“ (pvz., DeepStack, Libratus) arba „StarCraft II“ (pvz., AlphaStar), naudodami specifinius algoritmus, tokius kaip metodu Fiktyvusis Žaidimas (Fictitious Play) arba išnaudojimo priešininko strategijos (Exploitability measures).

3. Decentralizuotas Mokymasis (Independent Learners)

Tai paprasčiausias metodas, kai kiekvienas agentas ignoruoja kitus agentus ir traktuoja juos kaip aplinkos dalį, naudodamas standartinius RL algoritmus (pvz., Q-learning, DQN). Nors šis metodas yra lengvai pritaikomas ir nereikalauja komunikacijos, dėl nestacionarumo jis dažnai nepavyksta didelės masto sistemose arba sudėtingose bendradarbiavimo užduotyse.

MARL Taikymas Realiame Pasaulyje

MARL potencialas keisti įvairias pramonės šakas yra milžiniškas, sprendžiant koordinavimo, sąveikos ir optimalaus sprendimų priėmimo problemas:

- Autonominės Transporto Priemonės ir Eismo Valdymas: Keli automobiliai, besidalinantys keliu, turi koordinuoti savo greitį ir trajektorijas, kad išvengtų susidūrimų ir optimizuotų eismą. MARL gali valdyti šviesoforus, kad sumažintų spūstis.

- Robotika ir Sandėliai: Robotų komandos, dirbančios bendrame sandėlyje, turi efektyviai pasidalinti užduotimis ir išvengti susidūrimų, kad maksimaliai padidintų našumą.

- Finansų ir Prekybos Rinkos: Keli prekybos agentai (botai) sąveikauja tarpusavyje, priimdami sprendimus, kurie keičia rinkos kainas ir dinamiką.

- Elektros Tinklų Valdymas: Agentai gali valdyti atskirus energijos gamybos šaltinius ir paskirstymą, siekdami optimizuoti sistemos stabilumą ir efektyvumą.

Apibendrinant, **Daugelio Agentų Mokymasis Stiprinant (MARL)** yra esminis žingsnis link sudėtingesnio, labiau į realybę panašaus dirbtinio intelekto kūrimo. Spręsdama iššūkius, susijusius su nestacionarumu ir koordinavimu, MARL leidžia sistemoms savarankiškai mokytis optimalių bendradarbiavimo ar konkurencijos strategijų, atveriant kelią naujoms automatizuotų ir autonominių sistemų kartoms.